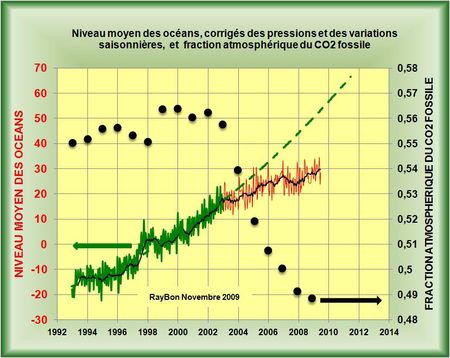

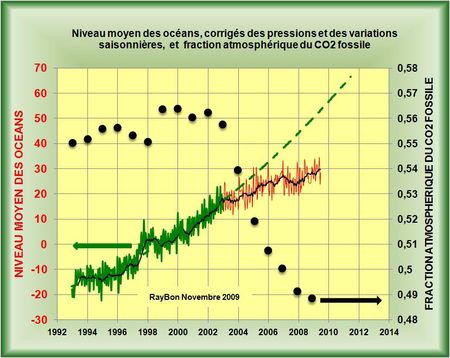

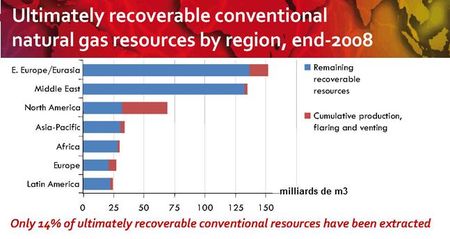

Il a été mentionné ici (LIRE) combien certains phénomènes récents pouvaient poser question dans le cadre de l'évolution du climat de notre planète. Deux paramètres apparaissent en particulier: la chute de la fraction atmosphérique du CO2 d'origine fossile (la vitesse d'apparition de CO2 dans l'atmosphère est plus lente que celle de sa formation par les activités humaines mesurables) et le changement de pente de la courbe du niveau moyen des océans en fonction du temps. Il apparaît intéressant de faire figurer les deux phénomènes sur un même graphique pour illustrer la simultanéité des phénomènes (FIG.I)

FIG.I : la quasi simultanéité du changement de pente de la croissance du niveau des océans et la variation brusque de la fraction atmosphérique du CO2 posent question.

Entre 1993 et 2002 la fraction atmosphérique (aFOSS) du CO2 émis par les activités humaines mesurables (combustion des énergies fossiles et production de ciment) était de l'ordre de 55 à 56%. A partir de 2003 cette proportion s'est mise à décroître pour atteindre 49% du CO2 émis en 2008 (FIG.I, gros points noirs). Sept points de variation de ce ratio, pour 33 milliards de tonnes de CO2 émises annuellement, cela représente annuellement dans les deux milliards de tonnes de CO2 absorbés en plus ou relargués en moins par les terres ou les mers.

Remarque: ce résultat n'est pas pur sucre, il peut être entaché par une modulation des émissions de CO2 liées aux variations d'utilisation des sols (LUC) par l'homme (destruction des forêts tropicales, reboisement, assèchement volontaire de zones humides, extension des zones cultivées, etc.). D'autre part, les climatologues distingués prennent généralement une valeur forfaitaire annuelle de 5,5 milliards de tonnes de CO2 pour quantifier ce paramètre, ce qui a pour effet de faire baisser le fraction atmosphérique qu'ils nomment alors aE. Mais cela ne change pas la nature du problème et aux 2 milliards de tonnes de CO2 perdus. (VOIR la comparaison des deux courbes).

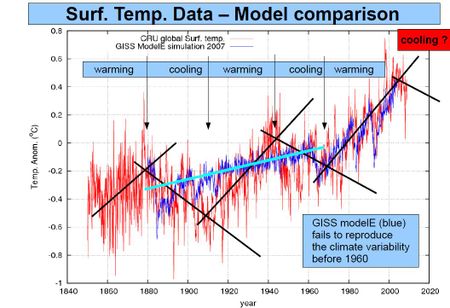

Durant la première phase du phénomène précédent le niveau moyen des océans s'est élevé selon une loi sensiblement quadratique (courbe verte, R2 =0.88 et moyenne mobile sur 6 mois en noir), puis, à partir de 2003 un changement de pente est perceptible. Pour bien comprendre ce phénomène il ne faut pas oublier que ce niveau des mers est une moyenne mondiale avec des parties des océans qui s'échauffent, comme l'Océan Indien par exemple, et de larges zones dans l'Océan Atlantique et dans l'Océan Pacifique qui se refroidissent.

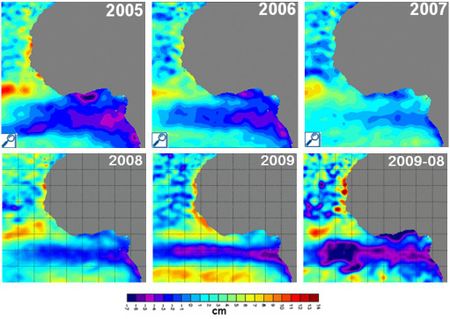

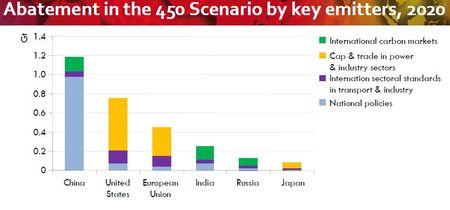

Par exemple on a vu en 2008 et surtout cette année la mousson revenir parfois brutalement sur le Sahel, en raison du refroidissement des eaux du Golfe de Guinée, condition nécessaire pour que s'établisse la mousson (FIG. II). En 2007 année calamiteuse de grande sècheresse dans la région, certains avaient déjà enterré la mousson à jamais, au nom du réchauffement climatique. Des précurseurs!

FIG.II : le retour d'eaux plus fraîches dans le Golfe de Guinée relance la mousson dans le Sahel

Remarque: pour comprendre ce phénomène de mousson africaine on pourra consulter la présentation de Jean-Luc Redelsperger au Collège de France (VOIR)

On ne peut donc que s'interroger sur la coïncidence des deux phénomènes décrits par la Figure I, en sachant que le rafraîchissement de certaines zones de surface océaniques peuvent accroître l'absorption de CO2 ou inversement dans les zones chaudes faire décroître le relargage du CO2 dissous dans les courants remontant en surface. La disparition de la banquise durant les mois d'été, la plus grande fréquence des pluies sont également des paramètres qui favorisent l'absorption de dioxyde de carbone.

Ces feedbacks puissants sur le cycle du carbone méritent d'être approfondis à partir de mesures systématiques des teneurs en CO2 dans les eaux de surface. L'absence du satellite OCO de la NASA, qui devait mesurer les teneurs en CO2 sur la surface du Globe et dont le lancement a échoué au début de cette année se fait durement sentir. Le suivi de ces deux pramètres dans les années à venir va permettre d'évaluer si une période de relative stabilité climatique est en train de se former. L'inertie thermique des masses océanes explique la lenteur et le décalage éventuels du phénomène.

Le 15 novembre 2009.

–