Il ne se passe pas une semaine sans que la littérature ne dévoile un nouveau procédé, un nouveau brevet ou un nouvel industriel qui va révolutionner l'industrie en gestation, de deuxième génération, (elle n'est pas encore née malgré les multiples faire-part) qui va convertir les matériaux lignocellulosiques les plus divers, en biocarburants de type essence, gasoil, éthanol, butanol ou autres dérivés du furfural.

Pourquoi cette profusion de nouveaux procédés et pourquoi ne voyons nous pas s'élever les rangs de cheminées d'usines de production de biocarburants de cette très attendue deuxième génération? A mon avis il y a quelques raisons très simples pour expliquer ce dynamisme en amont, dans les laboratoires et les ateliers de développement, et cet attentisme en aval, sur le terrain où devrait s'élever une usine.

- La crise économique bien sûr qui a freiné bien des projets. Les financiers ont refait les calculs et malgré les multiples aides étatiques, la rentabilité n'est pas au rendez-vous.

- La biomasse nécessite des cultures, des récoltes, de l'acheminement vers un centre de traitement et tout cela pour une densité énergétique très faible, 20 fois plus faible pour un m3 de paille que celle de l'essence.

- Pour ces raisons spatiales et de logistique, les futures unités industrielles devront être de taille et de complexité "agricoles", à la taille du canton, pilotées simplement par quelque dizaines d'opérateurs, nécessitant peu de maintenance et ne posant pas de problèmes de sécurité.

- Le produit obtenu doit être facile à isoler et à conditionner. Des "bières" à 4 ou 5 degrés d'alcool ne sont pas économiquement acceptables.

- Les catalyseurs de réactions, de types enzymes gloutons, ne peuvent pas coûter plus cher que l'éthanol ou le butanol produit.

On le voit les diverses contraintes logistiques, économiques, énergétiques et environnementales sont de puissants obstacles au développement des procédés d'élaboration de biocarburants de nouvelle génération. C'est la raison pour laquelle il est impératif de phosphorer fort dans les laboratoires.

Ne verront le jour industriel et ne se développeront que les procédés simples, économes en capitaux et aisés à conduire.

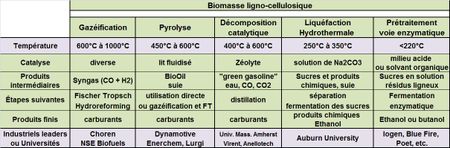

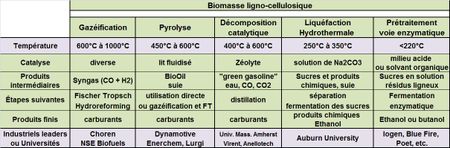

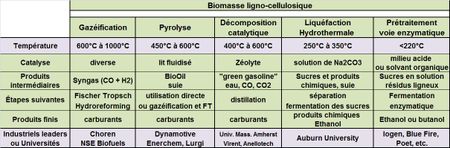

Pour se faire une idée des diverses grandes familles de procédés il est intéressant de les trier selon le premier traitement qui va être appliqué. Ces traitements du plus destructeur au plus doux, vont de la gazéification pure et simple qui conduit au syngas CO+H2 à une hydrolyse douce en milieu acide pour faire passer la cellulose et une part d'hémicellulose en solution qui sera ensuite soumise à fermentation (FIG.).

Remarque: cette classification est très réductrice, dans les faits les procédés, souvent complexes, s'entrecroisent ou se chevauchent, en raison d'une très grande créativité des scientifiques travaillant sur le sujet.

Le cahier des charges appelant un procédé simple et peu dangereux disqualifie tout procédé de type Ficher-Tropsch qui nécessite de très gros investissements. La gazéification ne peut se concevoir qu'en appoint d'un procédé existant (LIRE) de type coal-to-liquid. La pyrolyse est simple mais elle conduit à un produit intermédiaire complexe et instable. Les procédés enzymatiques sont à la recherche de l'enzyme universel et pas cher, qui conduirait à des solutions concentrées en éthanol. Il ne semble pas être encore tout à fait au point.

Aujourd'hui les regards se portent vers la décomposition catalytique de la lignocellulose et les travaux de l'Université du Massachusetts Amherst qui portent sur la pyrolyse catalytique rapide en présence de zéolites entre 400°C et 600°C. C'est le jeune et dynamique George Huber qui semble avoir le mieux compris l'équation, en proposant un procédé de conversion catalytique directe qui partant de sciure de bois conduit à un mélange de "green gasoline" et d'eau. La rusticité du procédé semble a priori suffisante pour justifier enfin un certain enthousiasme. Un spin-off, Anellotech, vient d'être créé pour exploiter en exclusivité les droits du procédé développé par Huber.

REGARDER absolument la video qui montre George Huber expliquer en laboratoire le procédé, cela vous changera de nos airport-professeurs souvent guindés des Universités européennes.

Le 30 Août 2009.

-