L'actualité nous apporte régulièrement des études plus ou moins pertinentes sur l'avenir des technologies électriques dans le marché des futures voitures et autres 4X4, d'ici à quelques décennies. C'est le cas de Transport & Environment qui sort un papier assez roboratif intitulé "How to avoid an electric chock" qui s'inspire lui même d'un rapport Mc Kinsey sorti au mois de mai de cette année. Ce genre de papiers qui essaient de se projeter à 20 ans de là, sans très bien connaître et prendre en compte ce qui se trame dans les bureaux d'études des grands constructeurs automobiles, doit toujours être pris avec beaucoup de philosophie. Alors, plutôt que d'essayer de prédire de façon assez illusoire l'avenir avec une grande précision, il me paraît plus important de dégager les grandes tendances technologiques, économiques et démographiques qui sont susceptibles d'infléchir les choix des équipes marketing de ces grands Groupes automobiles et donc de ceux des futurs consommateurs.

Tout d'abord cette industrie automobile, gravement percutée par la crise, est confrontée à une nécessaire adaptation de sa gamme de produits aux contraintes énergétiques et environnementales. L'efficacité énergétique et les qualités environnementales des produits proposés seront à la fois un puissant argument de vente et une réponse aux contraintes règlementaires qu'il faut imaginer de plus en plus strictes et planificatrices.

Le deuxième input va concerner les choix des constructeurs automobiles chinois qui dans leur dialogue avec les leaders du régime en place, risquent d'opter pour des solutions innovantes, forts de leur industrie des batteries et de leurs ressources en lithium et autres terres rares; un saut technologique est possible.

Le troisième paramètre important est le processus d'urbanisation et de vieillissement des populations qui va s'opposer à l'expansion du parc automobile et à l'utilisation de gros 4X4, à l'exception notable des Etats-Unis qui, en raison de l'espace disponible, constituent un marché à part, totalement différent de celui de l'Asie ou de l'Europe.

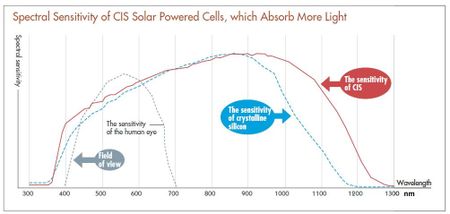

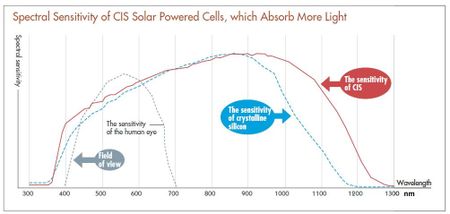

Le quatrième paramètre déterminant pour le futur est la synergie entre énergie photovoltaïque décentralisée, réseau électrique smart et véhicule électrique, que ce soit dans un cadre de vie de type pavillonnaire à l'américaine où dans des parcs de stationnement urbains équipés de stations de recharge alimentées par des modules photovoltaïques.

Enfin il ne faut pas oublier la voiture pour tous, style Tata Motors. Avec 2000 ou 3000 dollars il est difficile de proposer des technologies de pointe. Marché d'entrée de gamme dont les nuisances seront limitées par la présence de réseaux routiers inadaptés et encombrés, et dont le développement sera contrôlé par les autorités en place. Les 1,5 milliard d'Indiens attendus en 2030 ne pourront pas tous se déplacer en Tatamobile.

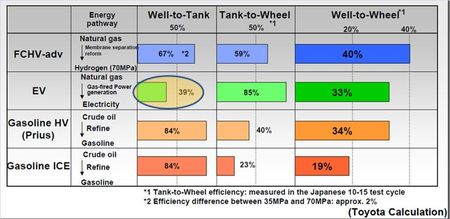

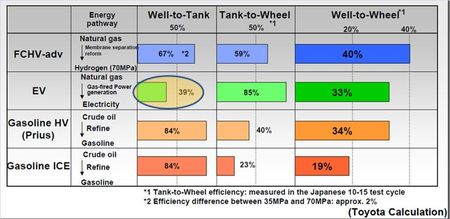

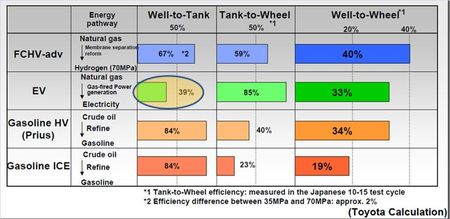

TAB.I : calcul du rendement énergétique du puits à la roue des diverses technologies de traction des véhicules.

A partir de cette grille de cinq idées forces il est, je pense, possible de rêver le futur. Mais voyons tout d'abord la contrainte énergétique et environnementale. Pour cela de façon très intelligible, ce qui se conçoit bien s'énonçant clairement, je vous propose de partir d'un tableau d'un industriel qui a un peu réfléchi au problème: Toyota. Ce constructeur décompose classiquement le bilan énergétique des divers modes de propulsion en deux facteurs: l'un qui est le bilan du puits de pétrole ou de gaz au réservoir d'essence ou à la batterie et l'autre qui représente le rendement intrinsèque du véhicule du réservoir à la roue. Pour lire ce tableau il faut partir de la ligne du bas, de la voiture à moteur à combustion interne (ICE). Que nous dit cette ligne? Que le Rendement énergétique moyen pour extraire du pétrole, le raffiner et distribuer l'essence produite est de 84%. Ce rendement n'ira pas en progressant dans le temps compte tenu de la difficulté croissante à explorer et exploiter les champs pétroliers offshore de plus en plus profonds, mais cet effort croissant est en partie compensé par l'amélioration des rendements en carburants des raffineries, aux dépens des résidus lourds peu valorisables. Par contre le rendement du moteur à explosion de papa avec 23% déglingue complètement le bilan énergétique qui ressort à 19%. Les quatre cinquièmes du pétrole exploité partent en chaleur. C'est la voie choisie par la Tatamobile et autres véhicules économiques

Bien sûr, entre cette solution de base et la version hybride de la ligne du dessus il existe bien des améliorations possibles. Mais l'hybridation couplée à un moteur d'excellent rendement, solution de la Prius, est à ce jour la solution énergétiquement la plus favorable puisque Toyota revendique un rendement énergétique du véhicule de 40% et donc un rendement global du puits à la roue de 34%. Dans ce cas les deux tiers du pétrole exploité sont dissipés en chaleur. Des progrès dans cette option hybride sont encore attendus avec la diésélisation par exemple, mais aussi avec l'allègement des véhicules grâce à l'utilisation de matériaux de type composites à fibres de carbone (LIRE). Il faut donc imaginer, pour des raisons énergétiques et environnementales le futur marché des véhicules à moteur à explosion avec un fort taux d'hybridation de 75 à 80%. A ce jour, 12% des voitures vendues au japon sont hybrides, ce n'est plus une activité marginale.

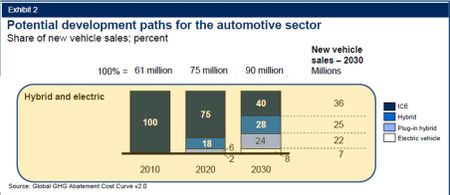

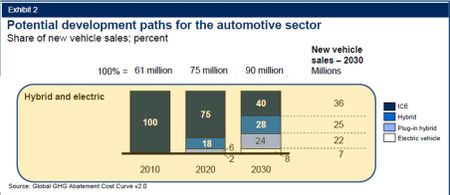

Le rapport Mc Kinsey (FIG.II) dans son hypothèse la moins détestable, envisage pour 2030 que sur 61 millions de voitures non électrifiées vendues en 2030 dans le monde, seulement 25 millions seront hybrides. Ceci indique une totale incompréhension de l'impact de la contrainte énergétique. Alors disons plutôt pour 2030 que se vendront dans les 15 millions de Tatamobiles et 46 millions d'hybrides, ce serait plus réaliste, si le marché en volume atteint une telle ampleur, soit 90 millions de véhicules vendus annuellement dans le monde.

FIG.II : la répartition de ventes des 90 millions (?) de véhicules par technologies à l'horizon 2030 par McKinsey en 2009.

Mais revenons au Tableau I et passons à la ligne au dessus, celle du véhicule électrique. Nous assistons alors à un chamboulement complet de l'équation. En effet, le rendement interne, de la batterie à la roue, devient excellent, 85% affirme Toyota. Ce rendement du véhicule est appelé à progresser encore en travaillant sur les rendements de l'électronique de puissance, de la batterie, sur la masse du véhicule, sur son isolation thermique, sur son coefficient de pénétration dans l'air, ou en l'équipant de modules solaires à haut rendement. En effet c'est l'autonomie, point faible des EV qui est en jeu. Pudiquement Toyota choisit une génération d'électricité au gaz naturel avec un rendement global de 39% pour que l'ensemble soit juste en dessous de la version hybride.

Au départ de la mise sur le marché des véhicules électriques qu'ils soient purs EV ou Plug-in Hybrides, les besoins en électricité supplémentaires seront marginaux. Par exemple un parc automobile de la Zone Euro à 10% électrique, à savoir composé de 20 millions de véhicules, consommant annuellement chacune (16000 km X 15 kWh/100 km / 0.8 rendement de charge et pertes en lignes) 3000 kWh, conduira à une consommation d'électricité supplémentaire de 60 TWh. Il faut savoir que la Zone Euro consomme aujourd'hui 2238 TWh d'électricité.

10% du parc automobile de la Zone Euro électrifié ne consommera, avec 20 millions de véhicules, que 3% de la consommation globale d'électricité.

Si l'on retient l'hypothèse de McKinsey avec une proportion de voitures électriques dans les ventes de 32% à l'horizon 2030, la Zone Euro se dirigerait alors vers un parc de 65 à 70 millions de voitures électriques qui ne consommeraient que dans les 200 TWh d'électricité par an. Il faut donc bien comprendre que l'électrification du parc automobile ne change pas fondamentalement les besoins en électricité d'un pays développé. Par contre elle change fondamentalement sa consommation en produits pétroliers.

Il faut donc pour juger des bienfaits ou des inconvénients de l'électrification du parc automobile raisonner en marginal. Par rapport à mon outil de génération d'électricité existant qui crache pas mal de CO2 dira un Grolandais que faut-il que j'ajoute en moyens marginaux de production pour que cette électrification se traduise par zéro émission de CO2 supplémentaire? Il va bien sûr penser aux énergies renouvelables et va utiliser la synergie entre génération photovoltaïque locale et véhicule électrique. Si sur le toit de mon garage j'ai des modules photovoltaïques qui produisent les 20 kWh quotidiens nécessaires à recharger mon véhicule, non seulement je ne consommerai pas d'électricité polluante grolandaise et je ne passerai plus jamais à la pompe. Sans oublier que le Président, en homme politique, fera installer des chargeurs solaires sur les parkings de la Place de la Mairie et, en homme d'affaires, sur les parkings de son Supermarché afin que ses citoyens le réélisent et viennent faire leurs achats chez lui.

Imaginer ce que sera le marché de la voiture dans le monde en 2030 et au delà nécessite donc d'intégrer l'arrivée massive des énergies renouvelables domestiques qui seront complémentaires du mode de traction électrique en cours de développement.

Enfin, un petit mot sur l'option Fuel Cell Hybrid. Selon Toyota qui croit beaucoup à cette technologie pour le futur, elle présenterait un rendement énergétique de conversion du gaz naturel en hydrogène, par reforming catalytique et séparation par membrane, de 67%, quand à la pile à combustible avec un rendement de 59% elle serait donc déchargée à 0.87V par élément en moyenne, ce qui suppose que toutes les pointes de courant seraient absorbées par une grosse batterie en tampon. Le retour à cette solution demande d'abandonner pour un bon bout de temps les énergies renouvelables. Une option pour de grosses voitures de prestige de la marque Lexus?

Il faut donc imaginer un futur de la bagnole avec un fort taux d'hybridation des véhicules à combustion interne, à l'exception des produits "indiens" d'entrée de gamme. Quand aux gammes électriques elles risquent de devenir majoritaires dans des pays fortement administrés comme la Chine et prendre une part importante du marché dans les immenses métropoles américaines ou les banlieues des villes européennes, mais alors couplées avec une génération domestique photovoltaïque d'électricité. Ces évolutions ne se feront qu'avec des investissements massifs de la profession et de ses sous-traitants et une régulation administrée à long terme des prix de la tonne de CO2 qui ne devra pas dépendre des humeurs fantasques de la spéculation. Il faut donc abandonner les systèmes de marché libre de Cap & Trade, ou les borner par le haut et par le bas comme proposent certains, ce qui revient au même.

CONSULTER le rapport de T & D et CELUI de McKinsey

Le 16 Novembre 2009.

–